Pravidelní návštěvníci sociálních sítí si v poslední době nemohli nevšimnout záplavy selfie se zelenými rámečky. Nad rámečkem se objevovala slova definující osobu na fotce jako „sleeping beauty“, „nerd“ nebo „camper“. ImageNet Roulette, aplikace, která tuto umělou inteligencí vybranou charakteristiku umožňovala, se dočasně stala po FaceApp dalším boomem internetu. Trend filtrů a aplikací s funkcí rozpoznávání obličeje (facial recognition) nabírá na popularitě již několikátým rokem. Kolem zábavy, která vám umožňuje rozšířit fotku o umělou realitu nebo vás udělá o padesát let starší, se během letošního roku rozvinula diskuse o ochraně osobních údajů. Aplikace ImageNet Roulette však přichází se zcela novým problémem, který je znepokojivý nejen v rámci internetu.

Předpojatost vůči menšinám a chudším lidem

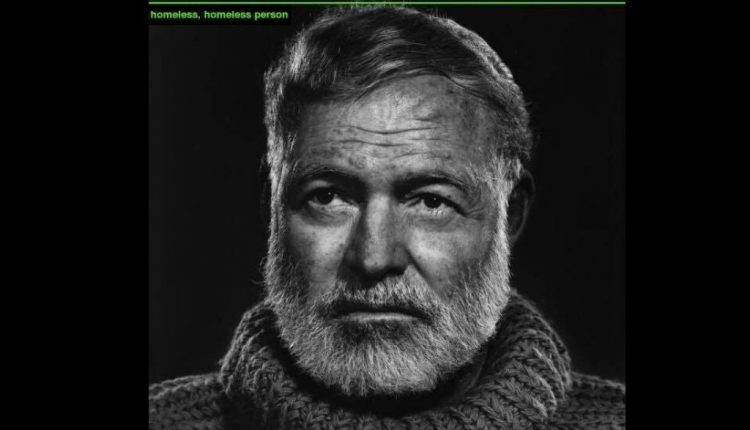

Během projektu, který skončil na konci září, se pod twitterovým hashtagem #ImageNetRoulette objevovaly příspěvky, na kterých lidé pobaveně ukazovali svoje selfie. Po čase se však začala množit kritika poukazující na zaujatost a xenofobii vůči různým menšinám a lidem s nižším sociálním statusem.

Tréninkové datasety jakožto základ pro vývoj nových technologií by měly být co nejdemokratičtější a nejtransparentnější. Většinou jsou ale ve vlastnictví soukromých korporací.

Jak se později ukázalo, uživatelé ImageNet Roulette se stali součásti masivního experimentu umělce Trevora Paglena a výzkumnice Kate Crawford. Projekt, který vyvrcholil aktuální výstavou s názvem Training Humans v milánském Fondazione Prada, byl vytvořen právě na základě dat sesbíraných prostřednictvím aplikace ImageNet Roulette. Tato aplikace s funkcí rozpoznávání obličeje kategorizovala uživatele na základě gigantické obrazové databáze ImageNet. Ta byla založena v roce 2009 na půdě Stanfordovy univerzity, čítá více než čtrnáct milionů snímků a slouží hlavně jako tréninkový dataset pro umělou inteligenci (AI). Tím, že se stala základním zdrojem pro projekt ImageNet Roulette, napomohla k otevření palčivých otázek ohledně budoucnosti umělé inteligence. Kdo vytvořil a vlastní datasety, na kterých se trénují algoritmy? A jakým způsobem AI snímky kategorizuje a interpretuje?

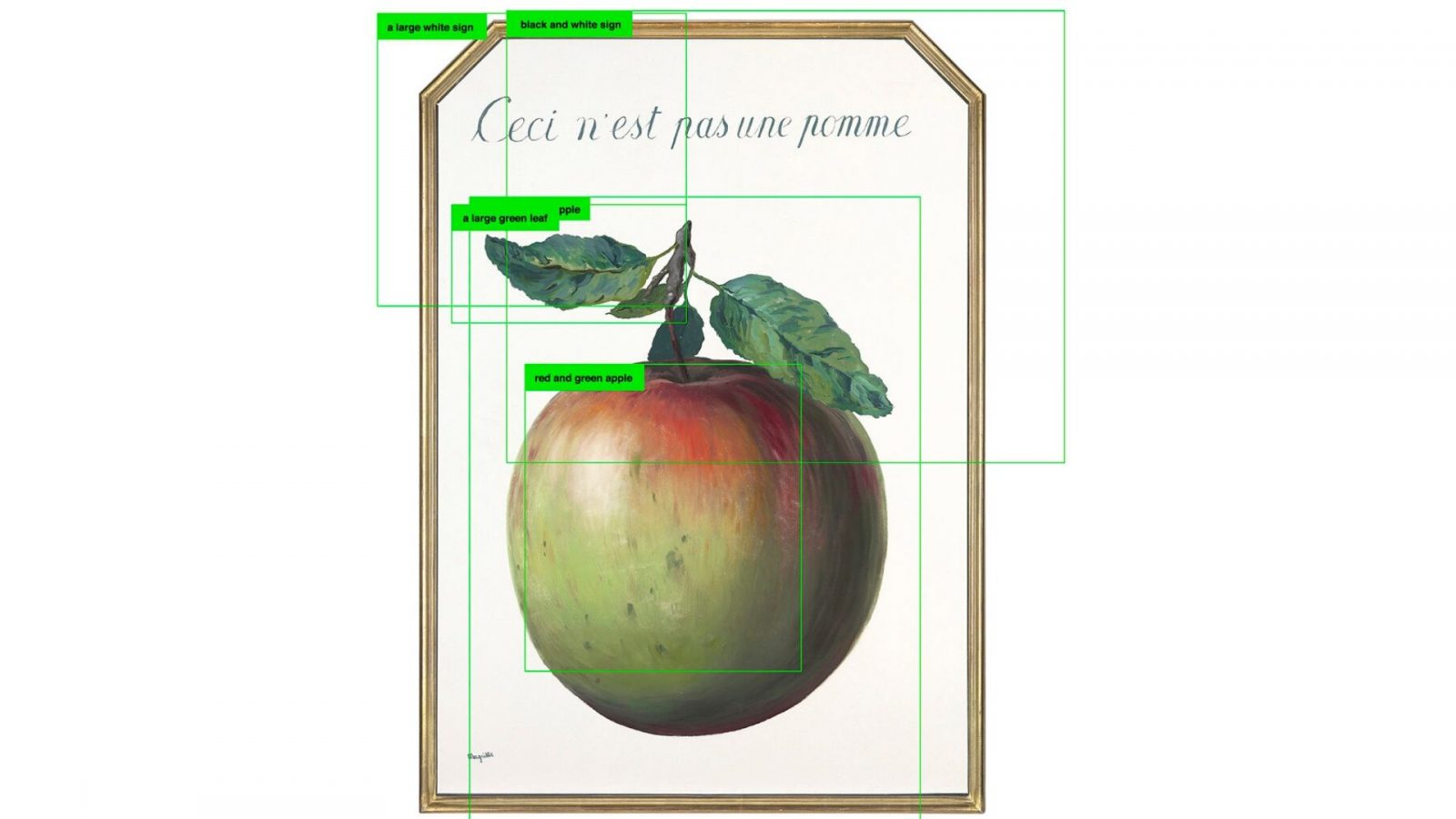

Tohle je jablko, bohužel

Komplexnost vnímaní a vykládání obrazů kolem nás je založena na nepřeberném množství faktorů. Sociální status, gender a národnost jsou jen některé z nich. Podobně s interpretací pracuje umění, jehož nedílnou součástí je i vnitřní imaginace. Obraz surrealistického malíře Reného Magritta Toto není jablko je snad nejslavnějším příkladem toho, jak lze různými způsoby vykládat význam stejného obrazového materiálu. Na Magrittově obrazu je červeno-zelené jablko, které se vznáší na krémovém pozadí, a nad ním stojí nápis „Ceci n’est pas une pomme“ (Toto není jablko). Věta má v sobě dalekosáhlé politické poselství poukazující právě na moc interpretace.

Umělá inteligence se učí umění interpretace na základě zmíněných datasetů skládajících se z mnoha milionů snímků. Metodika, jakou jsou snímky zařazovány do kategorií, se ovšem liší. V případě ImageNet jde o ruční práci najatých pracovníků tzv. Amazon Turk Workers. Ti škatulkují každý jednotlivý snímek podle předem připraveného rastru. Rastr, lépe řečeno taxonomie, je hierarchická struktura, kterou navrhli vývojáři databáze ImageNet. Kromě zcela nevyhovující metody třídění snímků, která je založená na pouhém pracovníkově úsudku, je i samotný původ materiálu zcela neetický. Fotografie v databázi jsou v mnoha případech používány bez svolení jejich vlastníků. Často se tak jedná o intimní fotografie z výletů, dovolených nebo profilové fotky uživatelů internetu.

Pro umělou inteligenci je „tréninková knihovna svým způsobem slovníkem a gramatikou vidění,“ říká autor projektu Trevor Paglen. Je to filtr pro vidění okolního světa s obrovským mocenským potenciálem. Vývojáři totiž můžou rozhodovat o vašem pohlaví a rase na základě povolených a naprogramovaných kolonek. ImageNet je v tomto ohledu zvlášť kontroverzní, a to mimo jiné díky nelichotivému označení lidí s odlišnou sexualitou a genderovou identifikací. V reakci na zveřejnění projektu došlo sice ke smazání rozporuplných 600 000 snímků z databáze, nicméně struktura taxonomie zůstává stejná. A tak jsou i dnes k vidění pozůstatky dříve plných kolonek. Například bisexuály byste našli v kategorii „hermaphrodite“.

Nejistá budoucnost

Kategorizace na základě stávajících tréninkových knihoven má kromě vlivu na osobní svobodu dopad i na naše finance. Masivní rozšíření technologie rozpoznávání obličejů se totiž kromě letištních kontrol pasažérů využívá i u sjednávání pojistek, jako je tomu v případě americké pojišťovny State Farm. Ta v roce 2016 rozjela projekt s 1440 účastníky, kteří si jako odměnu za účast rozdělili 65 000 dolarů. Do svých automobilů si nechali nainstalovat kamery s funkcí rozpoznávání obličeje, které měly monitorovat jejich „rizikové chování“ během jízdy. Experiment měl pomoci ušetřit pojišťovně peníze prostřednictvím dat sesbíraných z kamer. Na jejich základě měla pojišťovna do budoucna vykalkulovat výši individuální pojistky. Vedle zcela jasně definovaného rizikového chování, jakým je manipulace s mobilním telefonem, byly za rizikový faktor považovány i některé druhy negativních emocí a nervozita. Nicméně State Farm není jediným pojišťovacím domem, který zapojuje AI technologie do obchodních plánů. Podobně jsou na tom Liberty Mutual a Progressive. Díky těmto pokusům se ve světě začíná tvořit nebezpečný precedens pro využívání AI technologii, a to i přes nejasnosti a kontroverze, které panují ohledně jejich etiky a zaujatosti vůči menšinám.

Výzev pojících se s používáním technologie rozpoznávající obličeje je několik. Zaprvé, je nutné se zaměřit na vlastnictví tréninkových databází. Ty jsou zpravidla soukromým projektem. Tak je tomu i v případě databáze ImageNet, která je vlastněná soukromou Stanfordovou univerzitou a sponzorovaná Googlem a Amazonem. Soukromé laboratoře a vývojová centra by měly co nejvíce spolupracovat s veřejností, anebo podobné databáze s citlivými údaji nevlastnit vůbec. Tréninkové datasety jakožto základ pro vývoj nových technologií by měly být co nejdemokratičtější a nejtransparentnější.

Už se nesmí opakovat xenofobní označování, které odhalil umělecký projekt ImageNet Roulette. Toho můžeme docílit zapojením co možná nejširšího spektra lidí do tvorby databází, kteří rozhodnou o svém vlastním označení. Přicházející čtvrtá průmyslová revoluce bude zkrátka zásadní společenskou změnou, která se nám může lehce vymknout z rukou. Bude to spíše splnění utopických vizí, nebo jeden z dalších dílů série Black Mirror?

Autor je publicista.